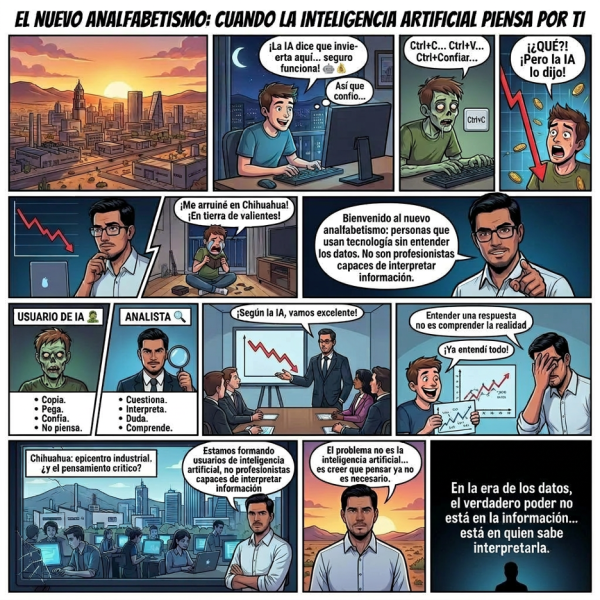

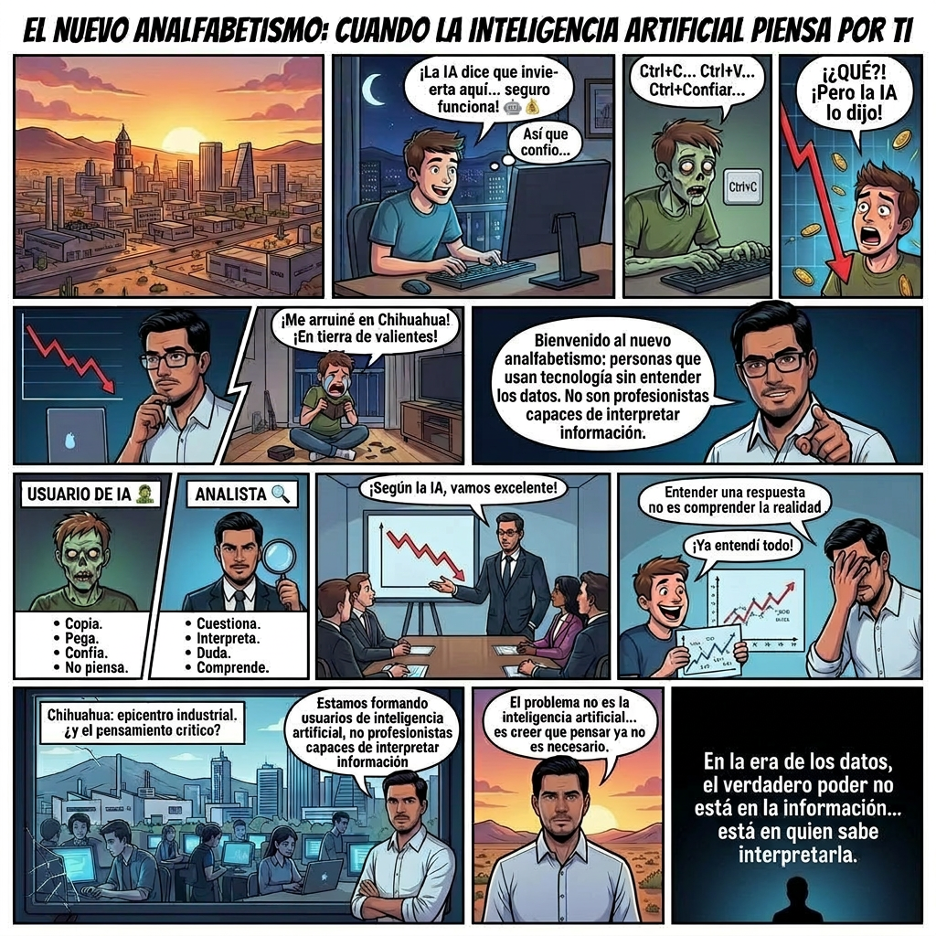

El nuevo analfabetismo: saber usar inteligencia artificial sin entender los datos

M.A.R.H Salvador Acevedo Ortega

Docente universitario en la Universidad Autónoma de Chihuahua, Facultad de Economía Internacional e Ingeniería

Nunca habíamos tenido tanto acceso a la información como ahora. Y, sin embargo, nunca había sido tan sencillo malinterpretarla.

En un aula universitaria, un estudiante utiliza inteligencia artificial para analizar tendencias de inversión. En cuestión de segundos obtiene recomendaciones, gráficos y proyecciones. Todo luce preciso, incluso sofisticado. Confía en el resultado, toma una decisión... y pierde dinero. No fue la inteligencia artificial la que falló. Fue la interpretación.

Esta escena, cada vez más frecuente, revela un problema silencioso que comienza a instalarse en nuestra sociedad: el nuevo analfabetismo. Ya no se trata de no saber leer ni escribir. Hoy, el rezago real está en no saber interpretar datos en una era dominada por algoritmos.

La paradoja es clara: mientras más herramientas tecnológicas tenemos, menos comprendemos los resultados que generan.

De usuarios a dependientes tecnológicos

En aulas, oficinas y hogares de Chihuahua, el uso de herramientas de inteligencia artificial se ha vuelto cotidiano. Desde redactar informes hasta analizar indicadores económicos o proyectar escenarios financieros, la IA ya forma parte de la vida laboral y académica de la región.

Pero esta integración ha avanzado más rápido que nuestra capacidad real para comprenderla.

Estamos formando usuarios de inteligencia artificial, no profesionistas capaces de interpretar información.

La diferencia es crítica. Un usuario ejecuta instrucciones y acepta resultados. Un profesionista analiza, cuestiona, contrasta y decide con criterio. Diversas investigaciones sobre alfabetización de datos —data literacy— advierten que la capacidad de interpretar información cuantitativa es hoy una competencia laboral tan esencial como saber redactar o hablar en público. Sin embargo, estudios en educación superior muestran que muchos estudiantes, pese a tener acceso a tecnología avanzada, presentan dificultades para evaluar la calidad de los datos, identificar sesgos estadísticos o comprender lo que implica una probabilidad. Saben usar la herramienta. No entienden lo que la herramienta produce.

El riesgo económico de no entender los datos

Este fenómeno no es únicamente un problema educativo. Tiene consecuencias económicas directas, medibles y costosas.

La mala interpretación de datos influye en decisiones cotidianas: elegir un crédito, invertir en un negocio, emprender o consumir. En un entorno donde la información circula en forma de gráficos automáticos, indicadores en tiempo real y predicciones generadas por algoritmos, interpretar mal un dato puede significar la diferencia entre prosperar y perder.

El economista conductual Daniel Kahneman demostró que los seres humanos no toman decisiones completamente racionales: están mediados por sesgos cognitivos persistentes. En la era de la inteligencia artificial, esos sesgos no desaparecen. Se intensifican.

Un gráfico mal entendido puede generar una falsa percepción de crecimiento. Una recomendación automatizada puede inducir confianza excesiva en escenarios que son, en realidad, especulativos. Un modelo predictivo puede asumirse como certeza cuando no es más que probabilidad con márgenes de error. La inteligencia artificial no elimina el error humano. Lo amplifica, lo escala y lo presenta con una apariencia de autoridad científica.

"La inteligencia artificial no elimina el error humano. Lo amplifica, lo escala y lo presenta con apariencia de autoridad."

En una economía como la de Chihuahua —marcada por la industria manufacturera, el comercio internacional, los servicios y una posición estratégica en la frontera con Estados Unidos— esta brecha cognitiva puede traducirse en malas decisiones empresariales, inversiones equivocadas y pérdida sostenida de competitividad.

Educación: el punto crítico

El sistema educativo enfrenta aquí uno de sus desafíos más profundos de las últimas décadas.

Durante años, la enseñanza ha priorizado contenidos memorísticos y, más recientemente, la adopción de herramientas digitales. Sin embargo, la interpretación de datos, la estadística aplicada y el pensamiento probabilístico siguen siendo las grandes asignaturas pendientes en la formación universitaria y de bachillerato del país.

No basta con enseñar a usar tecnología. Es necesario enseñar a entenderla.

La alfabetización de datos no implica saber programar ni dominar software complejo. Implica desarrollar habilidades más profundas: leer e interpretar gráficas con criterio, comprender relaciones entre variables sin confundirlas con causalidad, evaluar la calidad y procedencia de la información, e identificar errores, sesgos y manipulaciones estadísticas. Sin estas competencias, la inteligencia artificial se convierte en una caja negra: genera respuestas que el usuario acepta sin cuestionar porque carece de los elementos para hacerlo. Y ahí radica el problema central.

La ilusión del conocimiento

Uno de los efectos más peligrosos de la inteligencia artificial es la ilusión de comprensión. Al recibir respuestas claras, bien estructuradas y entregadas en segundos, los usuarios tienden a asumir que han entendido el problema. Pero entender una respuesta no es lo mismo que comprender su significado, sus limitaciones y su contexto.

La psicología cognitiva ha documentado ampliamente que las personas suelen sobreestimar su nivel de conocimiento cuando tienen acceso a información organizada visualmente. Este fenómeno, conocido como ilusión de conocimiento, se intensifica en entornos digitales donde la presentación de datos simula profundidad analítica.

Creemos que sabemos más de lo que realmente sabemos.

Y en economía, esa ilusión se paga. Un empresario chihuahuense que toma decisiones de expansión basado en proyecciones de IA que no comprende está apostando su capital —y el empleo de su gente— a una caja negra que él mismo no sabe leer. La confianza excesiva en los algoritmos, cuando no está respaldada por criterio analítico propio, no es eficiencia tecnológica: es vulnerabilidad disfrazada de modernidad.

Chihuahua ante el reto digital

Chihuahua no está al margen de esta transformación. La digitalización de procesos industriales, la automatización de líneas de producción y el uso creciente de inteligencia artificial en logística, control de calidad y gestión empresarial están redefiniendo el perfil laboral en la región a una velocidad inédita.

La pregunta ya no es cuántas personas usan tecnología. La pregunta urgente es cuántas la comprenden.

Si la adopción tecnológica no va acompañada de una formación sólida en interpretación crítica de datos, el resultado será una fuerza laboral dependiente de herramientas que no entiende plenamente, vulnerable a los errores que esas mismas herramientas producen y con escasa capacidad para adaptarse cuando los algoritmos fallen —porque eventualmente fallan.

Las economías que prosperan en la era digital no son necesariamente las que más tecnología despliegan. Son las que mejor la interpretan, las que desarrollan el juicio crítico para distinguir cuándo confiar en un algoritmo y cuándo cuestionarlo.

La hoja de ruta: competencias, no herramientas

Frente a este diagnóstico, la respuesta no puede reducirse a instalar más computadoras en las aulas ni a exigir que los estudiantes usen inteligencia artificial en sus trabajos finales. Se necesita un giro pedagógico profundo: incorporar el pensamiento estadístico, la evaluación de fuentes y el análisis crítico de datos como competencias transversales en todos los niveles educativos.

Se necesita, también, que las empresas del estado inviertan en la reconversión analítica de sus equipos, no solo en la automatización de sus procesos. Un operador que entiende los datos que genera su máquina es más valioso que uno que simplemente la opera. Un gerente que puede cuestionar los resultados de un modelo predictivo protege mejor a su organización que uno que los acepta sin reservas.

La inteligencia artificial seguirá avanzando. Su presencia en la educación, el trabajo y la vida cotidiana es irreversible. El desafío no es detenerla ni temerle. Es aprender a convivir con ella de manera crítica, exigente y consciente de sus límites. Porque el conocimiento real no está en la herramienta. Está en la capacidad de interpretarla.

El fondo del problema

El problema no es la inteligencia artificial. El problema es creer que entender una respuesta es lo mismo que saber interpretarla.

"En un mundo saturado de datos, la escasez ya no está en la información. Está en la comprensión."

Esa comprensión —crítica, contextualizada, honesta con sus propios límites— es, probablemente, el bien más escaso y más valioso que puede cultivar una región que aspira a prosperar en la era digital. El nuevo analfabetismo no anuncia su llegada. Ya está aquí. Y Chihuahua, como el resto del país, tiene la oportunidad —y la responsabilidad— de confrontarlo a tiempo.

REFERENCIAS

Kahneman, D. (2011). Thinking, Fast and Slow. Farrar, Straus and Giroux.

Schield, M. (2004). Information literacy, statistical literacy, data literacy. IASSIST Quarterly, 28(2-3), 6–11.

Prensky, M. (2001). Digital natives, digital immigrants. On the Horizon, 9(5), 1–6.

World Economic Forum. (2025). Future of Jobs Report 2025. weforum.org

Data Literacy Project. (2023). The Data Literacy Index. thedataliteracyproject.org