Chihuahua frente a la IA: ¿estamos preparados para decidir?

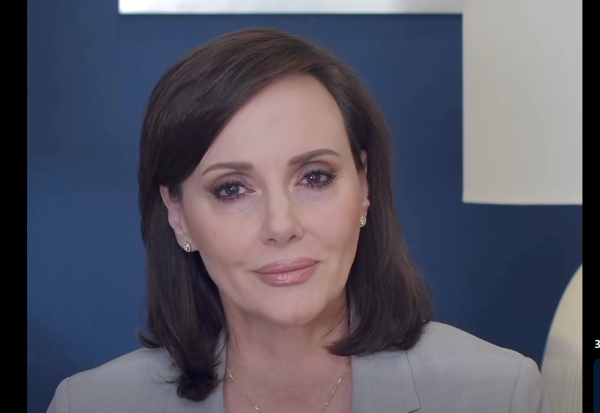

M.A.R.H Salvador Acevedo Ortega

Docente universitario en la Universidad Autónoma de Chihuahua, Facultad de Economía Internacional e Ingeniería

En Chihuahua, la conversación sobre inteligencia artificial suele comenzar con una pregunta práctica: cómo usarla. Qué herramientas existen, qué tareas puede automatizar, cuánto tiempo ahorra. Son preguntas legítimas y urgentes para una economía que opera en la frontera más activa del continente.

Pero hay otra pregunta —más incómoda y más importante— que rara vez se formula con claridad: ¿estamos preparados para decidir con ella?

Porque usar una herramienta no es lo mismo que entender sus consecuencias. Y en el territorio de las decisiones —económicas, laborales, personales— es donde la historia comienza a complicarse de maneras que ningún manual de usuario advierte.

La eficiencia que no descansa

La inteligencia artificial ha llegado a resolver problemas reales. Redacta, resume, analiza, predice. Hace en segundos lo que antes tomaba horas. En términos productivos, la evidencia internacional es contundente: la OCDE, en su informe The Impact of AI on Work and Well-being (2024), documenta que las organizaciones que adoptan herramientas de IA reportan ganancias de eficiencia significativas en tareas repetitivas de procesamiento de información, análisis de datos y generación de contenido.

Hasta ahí, la promesa se cumple.

El problema aparece en el párrafo que la mayoría de los reportes de eficiencia no incluye: el mismo informe advierte que la adopción intensiva de IA está asociada con un incremento medible en la carga cognitiva de los trabajadores, en los niveles de estrés reportados y en la sensación persistente de no poder desconectarse. La inteligencia artificial no solo acelera lo que hacemos. Acelera, de manera inexorable, lo que se espera de nosotros.

Y en Chihuahua, una región que ya operaba a ritmo exigente antes de la IA, esa aceleración llega sobre un sistema humano que no tenía mucho margen disponible.

Más datos, menos pausa, peores decisiones

Existe un supuesto implícito en la era digital que merece cuestionarse con datos: que más información produce mejores decisiones. La investigación en neurociencia cognitiva y psicología económica ha desmontado ese supuesto de manera sistemática.

El Nobel de Economía Daniel Kahneman demostró en su obra Thinking, Fast and Slow (2011) que la calidad decisional no depende del volumen de información disponible, sino de la capacidad del tomador de decisiones para procesarla con calma y criterio. Cuando esa capacidad se ve interrumpida por la urgencia, la fatiga o la sobrecarga, el cerebro activa lo que Kahneman llama el Sistema 1 —rápido, intuitivo, propenso al error— en lugar del Sistema 2 —lento, analítico, confiable. La IA, al entregar respuestas instantáneas y al crear la expectativa de inmediatez permanente, empuja sistemáticamente a los usuarios hacia el Sistema 1.

El neurocientífico Daniel Levitin lo complementa desde la biología en The Organized Mind (2014): cada vez que el cerebro cambia de tarea —lo que en un entorno de trabajo con IA ocurre decenas de veces por hora— consume glucosa y libera cortisol, la hormona del estrés. Microsoft Research lo verificó experimentalmente en 2021 con mediciones de electroencefalografía: los trabajadores que participan en reuniones virtuales sin pausas acumulan niveles de activación neurológica asociados al estrés significativamente más altos que quienes incorporan cinco minutos de descanso entre sesiones. Cinco minutos. Ese es el tamaño de la brecha entre el cerebro que decide bien y el que decide agotado.

"No falta información. Sobra. Y una mente saturada no decide mejor: decide más rápido, con menos claridad y más propensión al error."

Para el trabajador promedio de la industria maquiladora, el sector servicios o la vida profesional en Chihuahua, este fenómeno no es abstracto. Es la jornada que no termina cuando se apaga la computadora, la notificación que interrumpe el descanso, la sensación de estar permanentemente ocupado mentalmente incluso en momentos que deberían ser de pausa. La IA no inventó ese patrón. Pero lo está amplificando a una velocidad sin precedente.

El riesgo que no se ve: la erosión del juicio propio

Pero el verdadero problema no es el cansancio. El cansancio se recupera con descanso. El riesgo más profundo es otro, más silencioso y más difícil de revertir: el cambio gradual en la forma en que pensamos cuando nos acostumbramos a que algo piense por nosotros.

Cuando una herramienta responde de manera instantánea, con aparente coherencia y una presentación que simula autoridad analítica, se vuelve tentador —y progresivamente habitual— dejar de cuestionar. Delegar el análisis. Aceptar la respuesta. No se percibe como dependencia. Se percibe como eficiencia.

La psicóloga Sherry Turkle, del MIT, documentó en Alone Together (2011) y en trabajos posteriores cómo la disponibilidad permanente de sistemas que responden y validan reorganiza los patrones de búsqueda de confirmación de las personas, reduciendo la tolerancia a la ambigüedad y debilitando la disposición a construir criterio propio en condiciones de incertidumbre. Lo que Turkle observó en adolescentes con redes sociales opera hoy, con mayor sofisticación, en adultos que usan herramientas de inteligencia artificial generativa para tomar decisiones de negocio, académicas y personales.

El psicólogo Albert Bandura aportó el marco teórico que permite entender por qué esto importa tanto: su concepto de autoeficacia —la confianza en la propia capacidad para resolver problemas— es uno de los factores protectores más robustos documentados en la psicología del siglo XX. La autoeficacia predice la resiliencia ante el estrés, la perseverancia frente a los obstáculos y el bienestar emocional sostenido. Y la autoeficacia se construye con la experiencia repetida de enfrentar problemas y resolverlos con los propios recursos. Cada vez que delegamos sistemáticamente ese proceso a un algoritmo, no solo ahorramos tiempo: erosionamos la capacidad que nos protege cuando las cosas se complican.

“Lo más preocupante no es que la IA piense por nosotros. Es que nos acostumbremos a no hacerlo, y que ese hábito se instale tan despacio que no lo notemos hasta que lo necesitemos.”

Chihuahua: velocidad como cultura, criterio como urgencia

Este fenómeno adquiere un matiz particular en la realidad chihuahuense. La región ha construido su identidad productiva sobre la eficiencia: industria de exportación, maquila de precisión, comercio fronterizo que no se detiene, ritmo constante que es al mismo tiempo fortaleza económica y exigencia permanente. En Chihuahua, responder rápido no es solo una ventaja competitiva. Es, en muchos contextos, una condición de operación.

La inteligencia artificial no cambió esa lógica. La intensificó. Y en esa intensificación aparece una vulnerabilidad que no suele medirse en indicadores económicos: el desgaste de una sociedad que ya operaba cerca de sus límites cognitivos, ahora expuesta a herramientas que comprimen aún más los tiempos de respuesta y amplían las expectativas de disponibilidad.

La Organización Mundial de la Salud documentó en su World Mental Health Report (2022) que los trastornos de ansiedad son la categoría más prevalente de salud mental a nivel global, con más de 1,000 millones de personas afectadas. En México, la Encuesta Nacional de Epidemiología Psiquiátrica, coordinada por María Elena Medina-Mora y colaboradores del Instituto Nacional de Psiquiatría, documentó que los trastornos de ansiedad afectan a cerca del 14.3 por ciento de la población adulta a lo largo de su vida — la prevalencia más alta entre todas las categorías diagnósticas estudiadas. La UACH, al declarar 2025 como el año de la salud mental, reconoció que ese dato no es una estadística lejana: es una realidad presente en sus aulas, en sus laboratorios y en la vida cotidiana de su comunidad.

A eso se suma un contexto laboral que agrava la exposición. La OCDE documenta que México registra consistentemente una de las jornadas laborales más largas entre sus países miembros, con más de 2,100 horas trabajadas al año en promedio — significativamente por encima de la media de la organización. La inteligencia artificial no llega a una fuerza laboral descansada con margen disponible. Llega a una que ya operaba cerca de sus límites.

La inteligencia que no se puede delegar

La respuesta a este diagnóstico no es rechazar la inteligencia artificial ni proponer una desconexión que nadie está dispuesto a asumir. Esa salida es tan ilusoria como inevitable es la transformación que vivimos. La respuesta es más precisa y más exigente: aprender a usar estas herramientas con criterio, diseñando de manera deliberada los límites que los algoritmos no establecerán por nosotros.

Porque hay decisiones que ninguna herramienta puede asumir en nombre de una persona: interpretar la complejidad de un contexto propio, tolerar la incertidumbre sin colapsar, asumir las consecuencias de un juicio personal, construir la confianza de quien ha resuelto problemas difíciles con sus propios recursos. Esas capacidades no son residuos del pasado que la tecnología va a superar. Son la arquitectura del bienestar humano, documentada por décadas de investigación en psicología, neurociencia y economía conductual.

Chihuahua no tiene un problema de acceso a tecnología. Tiene algo más valioso y más urgente: la oportunidad de construir una cultura de uso inteligente de la IA — que preserve la velocidad donde es una ventaja, pero que defienda la pausa donde es una necesidad. Que forme profesionistas capaces no solo de usar estas herramientas, sino de saber cuándo no usarlas. Que reconozca que en la era de la inteligencia artificial, la ventaja competitiva más difícil de replicar no está en el algoritmo.

Está en quien sabe cuándo detenerse a pensar.

REFERENCIAS

Bandura, A. (1997). Self-Efficacy: The Exercise of Control. W. H. Freeman.

Kahneman, D. (2011). Thinking, Fast and Slow. Farrar, Straus and Giroux.

Levitin, D. J. (2014). The Organized Mind: Thinking Straight in the Age of Information Overload. Dutton.

Medina-Mora, M. E., Borges, G., Lara, C., Benjet, C., Blanco, J. y Fleiz, C. (2003). Prevalencia de trastornos mentales y uso de servicios. Salud Mental, 26(4), 1–16. Instituto Nacional de Psiquiatría.

Turkle, S. (2011). Alone Together: Why We Expect More from Technology and Less from Each Other. Basic Books.

Microsoft Research. (2021). Research Proves Your Brain Needs Breaks. microsoft.com/en-us/research

Organización Mundial de la Salud. (2022). World Mental Health Report: Transforming Mental Health for All. who.int

OCDE. (2024). The Impact of AI on Work and Well-being. oecd.org

OCDE. (2024). Hours Worked: Average annual hours actually worked. stats.oecd.org